Algoritmes discrimineren, blijkt keer op keer.

Algoritmes discrimineren, blijkt keer op keer.

Algoritmes discrimineren, niet alleen op kleur, maar ook op geslacht, afkomst of het hebben van een handicap. Ze hebben dan ook alles te maken met macht en ongelijkheid, volgens Cathy O’Neil, erkend nerd en schrijver van het boek ‘Weapons of math destruction’.

En zeker wanneer de computer zelf verbanden gaat leggen (machine learning), en je ook als programmeur niet meer weet wat er nu precies in die black box gebeurd, dan wordt het oppassen geblazen.

Een algoritme is eigenlijk niets meer of minder dan een wiskundige formule. In programmeertaal is het een instructie, een stukje code, om een probleem om te lossen. Als die algoritmes op basis van gegevens – dus bij het invoeren van data in computersystemen – zelfstandig beslissingen nemen én daarvan leren, dan noemen we het kunstmatige intelligentie.

We noemen het dan wel kunstmatige intelligentie, maar het is vooral menselijke intelligentie, die we nabootsen en reproduceren. Stop die menselijke intelligentie in de vorm van big data in de computer, geef op waarop je wilt classificeren (naam, inkomen, geslacht etc.) en de vooroordelen rollen eruit, maar nu verpakt als objectief en neutraal.

Profilering en targeting

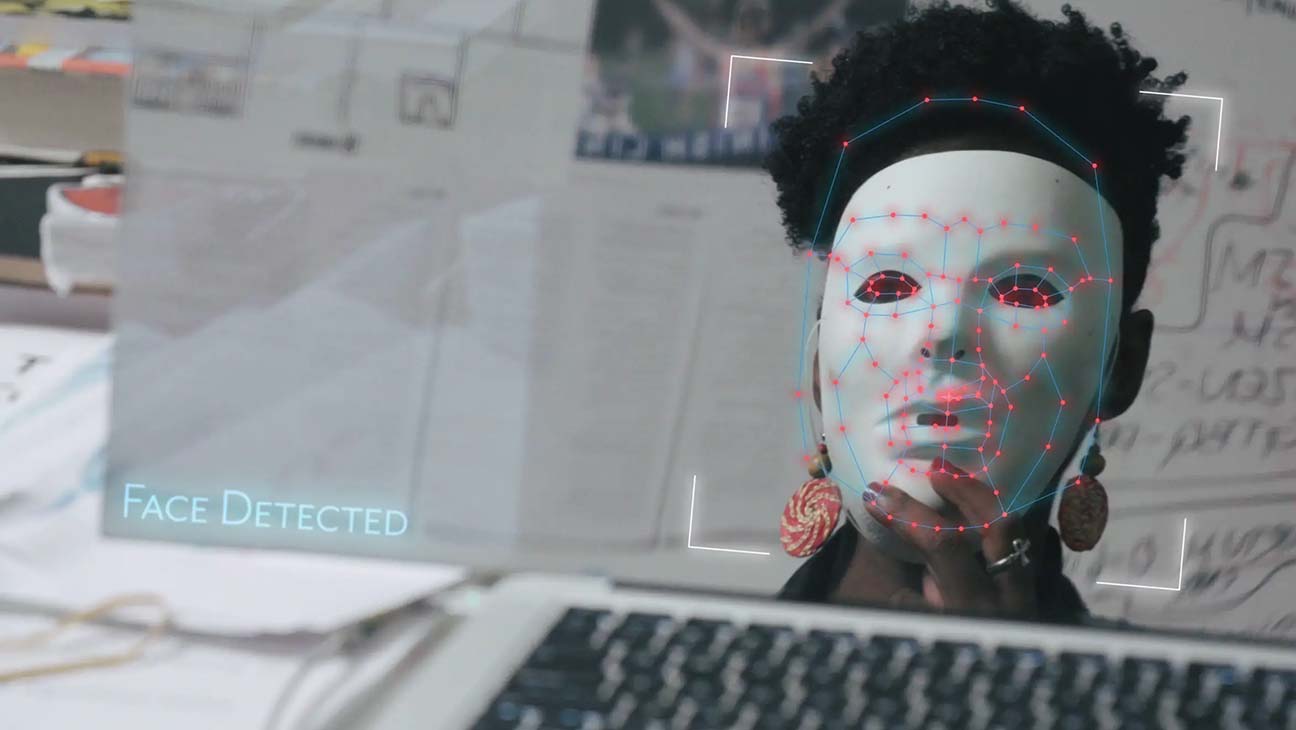

Dat zogenaamd objectief en neutraal pakt nogal eens verkeerd uit, Denk aan tunnelvisie bij de politie, die vooral jonge, zwarte mannen aanhoudt, medische missers (garbage in, garbage out) of het afschilderen van ouders als fraudeurs door de Belastingdienst, voornamelijk op basis van hun afkomst. Het gaat over het niet kunnen krijgen van een hypotheek vanwege naam en postcode. Over gezichtsherkenning die zo slecht is, dat mensen – lees: vooral zwarte mannen- ten onrechte geprofileerd en getarged worden. Het gaat over rechters, die algoritmes gebruiken om iemand te veroordelen, over excellente leraren die op basis van het algoritme toch ontslagen worden, over vrouwen die bij Amazon nooit door de selectie komen vanwege hun geslacht.

En het ergste is dat het een ongelijke strijd is, omdat je niet weet of er een algoritme in het spel is, wat voor data en criteria erin gestopt zijn en hoe het werkt. ‘Who owns the fucking code’! is daarmee een belangrijke vraag geworden, volgens O’Neil. Vooral omdat toezicht ontbreekt en de deur open staat voor misbruik.

Zwart + vrouw bestaat niet

In het Amerika van nu liggen de voorbeelden voor het oprapen. Zes van de negen grote techbedrijven die zich bezighouden met K.I. hebben hier hun wortels, zoals Google en Facebook. En die liggen niets voor niets onder vuur vanwege de schendingen van privacy.

Dat blijkt ook uit de film ‘Coded bias’ , een documentaire over negatieve gevolgen van onze moderne technologie. Tijdens haar werk aan de Massachusetts Institute of Technology (MIT) in Boston komt mediaonderzoeker Joy Buolamwini erachter dat gezichtsherkenningssoftware moeite heeft haar gezicht te herkennen. De reden? Haar huidskleur. Ze start een onderzoek naar de impliciete vooroordelen in kunstmatige intelligentie en ontdekt dat veel algoritmes vooral door witte mannen gemaakt worden, en daarom anders – of niet – reageren op mensen die niet man + wit zijn.

Kunstmatige intelligentie is hiermee intelligentie zonder ethiek. Het is garbage, rommel. Het is de fabeltjesfuik van Arjen Lubach.

Deze blog is geschreven door drs. J. (José) van Berkum, publiciste en zelfstandig adviseur. Ze gespecialiseerd in wonen, welzijn en technologie van senioren. Kijk ook op Anciano | Facebook en José van Berkum | LinkedIn